Роскомнадзор предложил сделать «суицидальный глоссарий» для поиска «групп смерти» во «ВКонтакте»

Планируется составить пособие для выявления опасного контента.

По утверждению официального представителя Роскомнадзора Вадима Ампелонского, специалисты должны будут создать методику, при помощи которой можно будет выявлять материалы о самоубийствах, а кроме этого создать «суицидальный глоссарий». При всем этом необходимо отделить представление пропаганды самоубийств от сведений об обстоятельствах, которые привели к смерти человека, и «черного юмора». В ведомстве отмечают потребность создания автоматизированной системы, которая, в идеале, должна маркировать подозрительный контент, а в случае подтверждения суицидального характера интернет-сообщества перекрыть и его, и пользователей, который этот контент распространяют.

По мнению руководителя Лиги безопасного интернета Дениса Давыдова, система мониторинга опасного контента должна быть автоматизирована: подозрительный контент должен маркироваться, а потом проверяться модератором «вручную».

— Система должна осуществлять мониторинг в автоматизированном режиме. С 52 тысяч страниц запрещенная информация удалялась собственной администрацией, а в 34,5 тысячах случаев контент блокировался с применением возможностей операторов связи. Потом проверяться вручную. Если факт подтверждается, нужно перекрыть и контент, и создателя. Если автор обновляется под новым именем и продолжает, нужно о нем сообщать в надзорные органы. Проблема с суицидами очень масштабная, и ее необходимо решать.

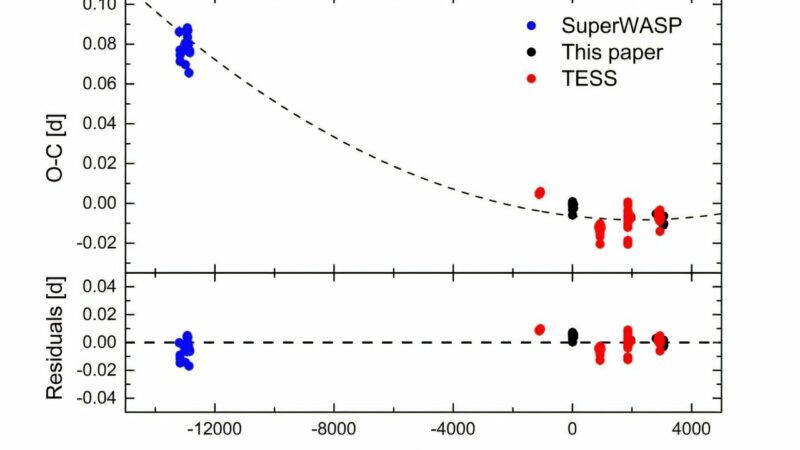

Конец года — время подведения итогов, и Роскомнадзор отчитался о блокировках противоправной информации в 2016 г.

Поделитесь в вашей соцсети👇