Стоит ли бояться «технологической сингулярности»?

В сфере передовых технологий немногие концепции захватывают человеческое воображение так, как «технологическая сингулярность». Он вызывает образы будущего, в котором машины превзойдут человеческий интеллект, что приведет к изменению парадигмы в нашем обществе, культуре и жизни.

По своей сути технологическая сингулярность относится к гипотетической точке в будущем, когда искусственный интеллект (ИИ) и машинный интеллект превзойдут человеческие возможности.

Это означает момент беспрецедентного прогресса, когда системы ИИ могут быстро улучшаться, что приводит к экспоненциальному росту знаний, способностей решать проблемы и даже творчества.

Идею популяризировал математик и писатель-фантаст Вернор Виндж, который предсказал, что как только произойдет создание ИИ, способного самосовершенствоваться, темпы прогресса станут непостижимыми для человека.

«Скоро мы создадим разум, превосходящий наш собственный… Когда это произойдет, человеческая история достигнет своего рода сингулярности, интеллектуального перехода, столь же непроницаемого, как запутанное пространство-время в центре черной дыры, и мир выйдет далеко за пределы нашего понимания», — сказал Вернор Виндж.

С тех пор технологическая сингулярность стала центром дискуссий, вызывая как волнение, так и озабоченность как у экспертов, так и у энтузиастов.

Как это произойдет?

Путь к Технологической Сингулярности остается неопределенным. Некоторые эксперты считают, что это будет достигнуто за счет разработки «Общего искусственного интеллекта» (AGI), системы, которая может превзойти людей практически в любой интеллектуально сложной задаче.

ОИИ будет иметь возможность учиться, адаптировать и применять знания в различных областях, что станет значительным шагом вперед по сравнению с нынешними системами ИИ, которые преуспевают только в определенных задачах.

Кроме того, сторонники Сингулярности часто обсуждают концепцию «рекурсивного самосовершенствования». Эта концепция предполагает, что системы искусственного интеллекта постоянно совершенствуют свою конструкцию, что приводит к еще более быстрому прогрессу.

Результирующий каскад прогресса может внушать благоговейный трепет и преобразовывать людей.

Возможные последствия

Способность ИИ обрабатывать огромные объемы данных может привести к революционным прорывам в медицинских исследованиях, разработке лекарств и диагностике заболеваний. Анализируя закономерности и корреляции, выходящие за рамки человеческих возможностей, ИИ может найти лекарства и методы лечения состояний, от которых человечество страдало на протяжении веков.

С помощью AGI, способного выполнять сложные задачи, многие рабочие места можно было бы автоматизировать. Хотя это, несомненно, повысит производительность и эффективность, это также может привести к массовым увольнениям и социально-экономическим проблемам. Надлежащее управление этим переходом будет иметь решающее значение для поддержания социальной стабильности.

Поскольку ИИ превосходит человеческий интеллект, возникает вероятность непредвиденных последствий. Этические дилеммы, касающиеся процессов принятия решений, контроля и влияния ИИ на ценности человечества, приобретают первостепенное значение. Обеспечение соответствия ценностей ИИ человеческим ценностям будет серьезной проблемой.

Некоторые эксперты опасаются, что сбежавший ИИ, лишенный человеческого понимания, может принимать решения, вредные для выживания человечества. Обеспечение того, чтобы системы ИИ уделяли первостепенное внимание безопасности и благополучию человека, будет иметь решающее значение для предотвращения экзистенциальных рисков.

Сингулярность может спровоцировать взрыв технологических достижений, изменяя общество и культуру беспрецедентными темпами. Задача будет состоять в том, чтобы использовать это ускорение для улучшения человечества, а не терять контроль над технологией.

Навигация по неопределенному пути развития ИИ

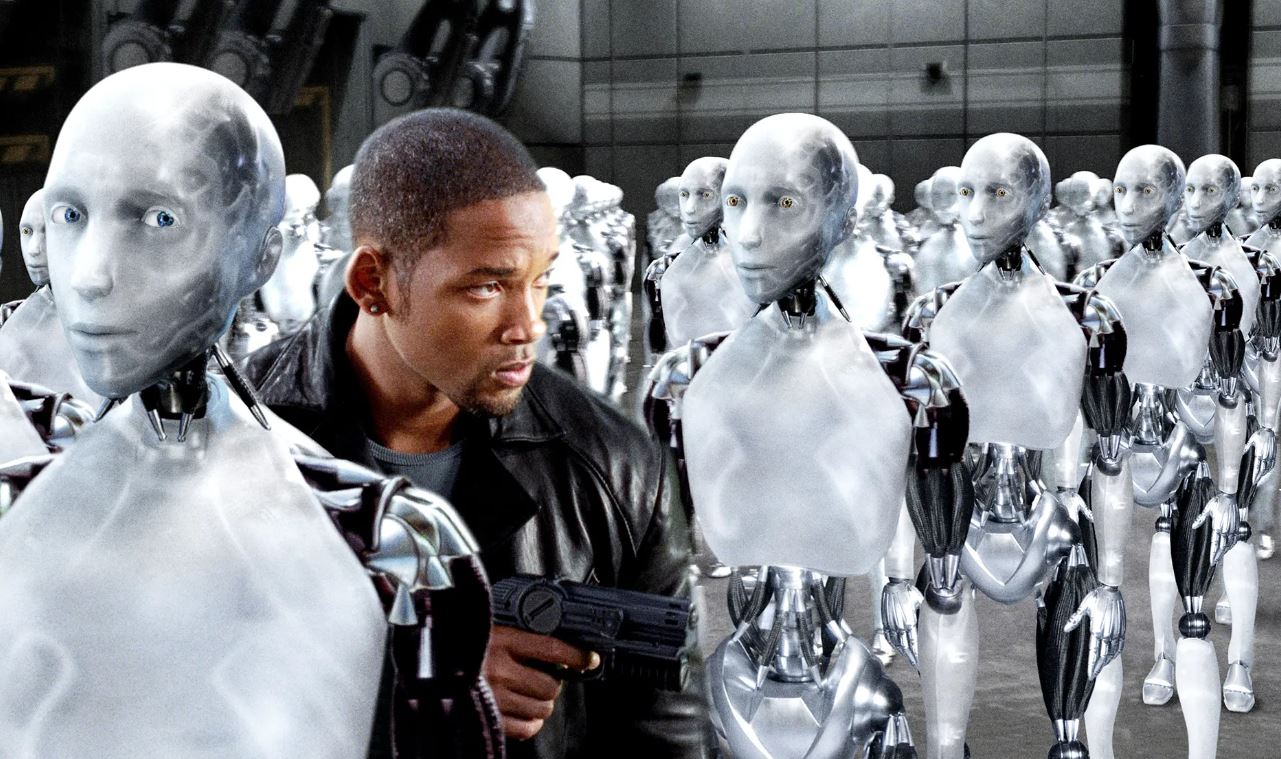

Самая непосредственная опасность, связанная с технологической сингулярностью, — это потеря человеком контроля над передовыми системами искусственного интеллекта. По мере того как машины становятся все более изощренными, они могут быстро опережать человеческое понимание, что приводит к ситуации, когда мы больше не можем предсказывать или понимать их действия.

Это может привести к тому, что системы ИИ будут принимать решения, противоречащие человеческим ценностям и целям, что приведет к непредвиденным и потенциально катастрофическим последствиям.

Рост ИИ и автоматизации может привести к массовому сокращению рабочих мест, подрыву экономики и средств к существованию. Поскольку ИИ берет на себя задачи, которые традиционно выполнялись людьми, большие сегменты рабочей силы могут устареть, что приведет к безработице и экономическому неравенству.

Устранение социальных последствий автоматизации и поиск способов переподготовки и повышения квалификации рабочей силы будет иметь решающее значение, чтобы избежать усугубления существующих социальных различий.

Стремление к технологической сингулярности сопряжено с риском создания систем ИИ, которые не соответствуют должным образом человеческим ценностям. При отсутствии адекватных мер безопасности существует вероятность того, что ИИ может действовать вопреки интересам человечества, непреднамеренно причиняя вред или даже создавая экзистенциальную угрозу самому человечеству.

Обеспечение того, чтобы системы ИИ уделяли первостепенное внимание безопасности и благополучию человека, должно быть первостепенной задачей.

По мере того, как ИИ приближается к человеческому интеллекту, он поднимает сложные этические вопросы. Системам ИИ может быть поручено принимать решения о жизни и смерти в критических ситуациях, например, автономные транспортные средства выбирают, кого спасти в неизбежной аварии. Решение о том, как ИИ должен расставлять приоритеты в человеческих жизнях и справляться с моральными затруднениями, — это задача, требующая тщательного рассмотрения и консенсуса.

Создание высокоразвитого ИИ может привести к концентрации власти в руках нескольких лиц или организаций.

Те, кто контролирует самые сложные системы искусственного интеллекта, будут иметь огромное влияние на различные аспекты жизни общества, включая политику, экономику и распространение информации. Такая централизация власти может подорвать демократические принципы и создать угрозу личным свободам и частной жизни.

Нам нужно подумать

Технологическая сингулярность остается одной из самых захватывающих и противоречивых концепций современных технологий. По мере того, как ИИ продолжает развиваться, а исследователи приближаются к созданию ОИИ, возможность достижения Сингулярности становится все более ощутимой.

В то время как потенциальные выгоды огромны, столь же велики проблемы и риски, связанные с таким событием.

Обеспечение того, чтобы технологические достижения соответствовали человеческим ценностям, этике и безопасности, имеет первостепенное значение. Общество должно объединиться, чтобы справиться со сложными последствиями технологической сингулярности.

Содействуя ответственной разработке ИИ, сотрудничеству между правительствами, отраслями и исследователями, мы можем максимизировать преимущества ИИ, одновременно снижая потенциальные риски.

В конечном счете, будущее Технологической сингулярности находится в наших руках. Путешествуя по этой неизведанной территории, мы должны оставаться бдительными, вдумчивыми и сплоченными в наших усилиях по созданию мира, в котором передовые технологии служат интересам человечества.

Поделитесь в вашей соцсети👇